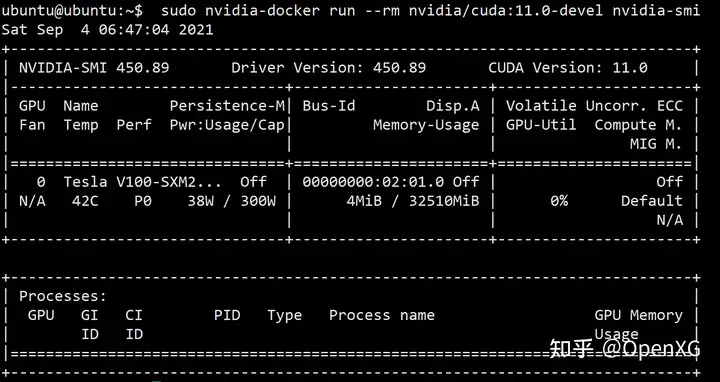

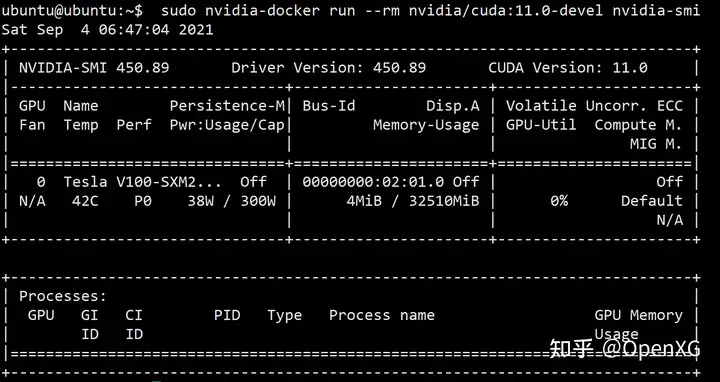

sudo nvidia-docker run --rm nvidia/cuda:11.0-devel nvidia-smi

3. 运行tensorflow-GPU docker版sudo docker run --runtime=nvidia -it --rm -v ~/Workspace/tfexamples/:/mnt tensorflow/tensorflow:latest-gpu python /mnt/test.py

--runtime=nvidia, 指明使用GPU环境,安装Nvidia-docker2的话,使用该参数;如果是Nvidia-docker1,使用--gpus all

-v ~/Workspace/tfexamples/:/mnt,将host主机目录映射到docker中

tensorflow/tensorflow:latest-gpu,使用tensorflow gpu 镜像;

python /mnt/test.py,指定运行的脚本或程序

4. 共享GPU方式的运行Docker Tensorflow共享GPU需要首先启动MPS服务:

export CUDA_VISIBLE_DEVICES=0 export CUDA_MPS_PIPE_DIRECTORY=/tmp/nvidia-mps export CUDA_MPS_LOG_DIRECTORY=/tmp/nvidia-log nvidia-cuda-mps-control -d

运行Docker Tensorflow-GPU

sudo docker run --runtime=nvidia --ipc=host -it --rm -v ~/Workspace/tfexamples/:/mnt tensorflow/tensorflow:latest-gpu python /mnt/test.py

--ipc=host, 指明GPU的使用连接至本机的Nvidia-docker,共享GPU

关闭MPS服务:

echo quit | nvidia-cuda-mps-control